AI Act : le guide de survie pour PME/ETI

Bistro IA . Numéro #4

☕ LE RISTRETTO

- Moins de 100 jours avant le 2 août 2026 : la date butoir pour les systèmes IA haut risque. Recrutement, scoring, santé. La majorité des PME concernées n’ont pas commencé.

- Certaines pratiques IA sont interdites en France depuis le 2 février 2025. Manipulation, score social, reconnaissance des émotions au travail. En vigueur. Maintenant.

- 35 M€ d’amende maximum. Mais ce n’est pas le vrai risque. Perdre un appel d’offres parce qu’un donneur d’ordres exige la conformité AI Act comme prérequis : ça, c’est déjà réel.

- Un report est probable (vote Digital Omnibus, 26 mars 2026), mais pas encore confirmé. Se préparer “pour plus tard” reste une erreur de calcul.

458 pages de texte juridique européen. Ce numéro vous donne l’essentiel en 8 minutes.

⚡ L’ESPRESSO

L’AI Act est partiellement en vigueur depuis février 2025. Pour la majorité des PME françaises, l’exposition réelle est limitée : les usages courants (ChatGPT, Copilot, outils de rédaction) ne tombent pas dans la catégorie haut risque. Là où ça se complique : le recrutement, le scoring client, la santé. Le vrai danger, lui, n’est pas l’amende. C’est l’appel d’offres perdu parce qu’un donneur d’ordres exige la conformité comme prérequis. Le calendrier complet, les obligations concrètes pour les déployeurs, et les 5 questions à poser à vos fournisseurs IA cette semaine.

🫘 LES GRAINS : Pourquoi l’AI Act concerne votre PME (même si vous ne faites pas d’IA)

Si vous utilisez un outil de scoring RH, un chatbot pour votre service client, un système de recommandation produit, ou un outil IA pour analyser vos données clients, vous êtes concerné par l’AI Act. Pas en tant que développeur, mais en tant que déployeur (le règlement les appelle “deployers”).

C’est le premier malentendu à dissiper : l’AI Act ne vise pas uniquement les créateurs de modèles IA. Il encadre aussi ceux qui les utilisent. Et une PME qui intègre ChatGPT dans son workflow CRM, ou qui utilise un outil d’IA pour trier des CV, est un déployeur au sens du texte.

Le second malentendu : “ce n’est pas encore en vigueur.” Si, partiellement. Les pratiques interdites (score social, manipulation subliminale, exploitation de vulnérabilités) sont interdites depuis le 2 février 2025. Les obligations de transparence pour les modèles d’IA à usage général (GPAI) s’appliquent depuis août 2025. Ce qui reste à venir, ce sont les obligations spécifiques aux systèmes haut risque.

Et même avec le report potentiel voté le 26 mars, les fondamentaux ne changent pas : si vous utilisez de l’IA dans un contexte sensible, vous devez comprendre vos obligations. Maintenant.

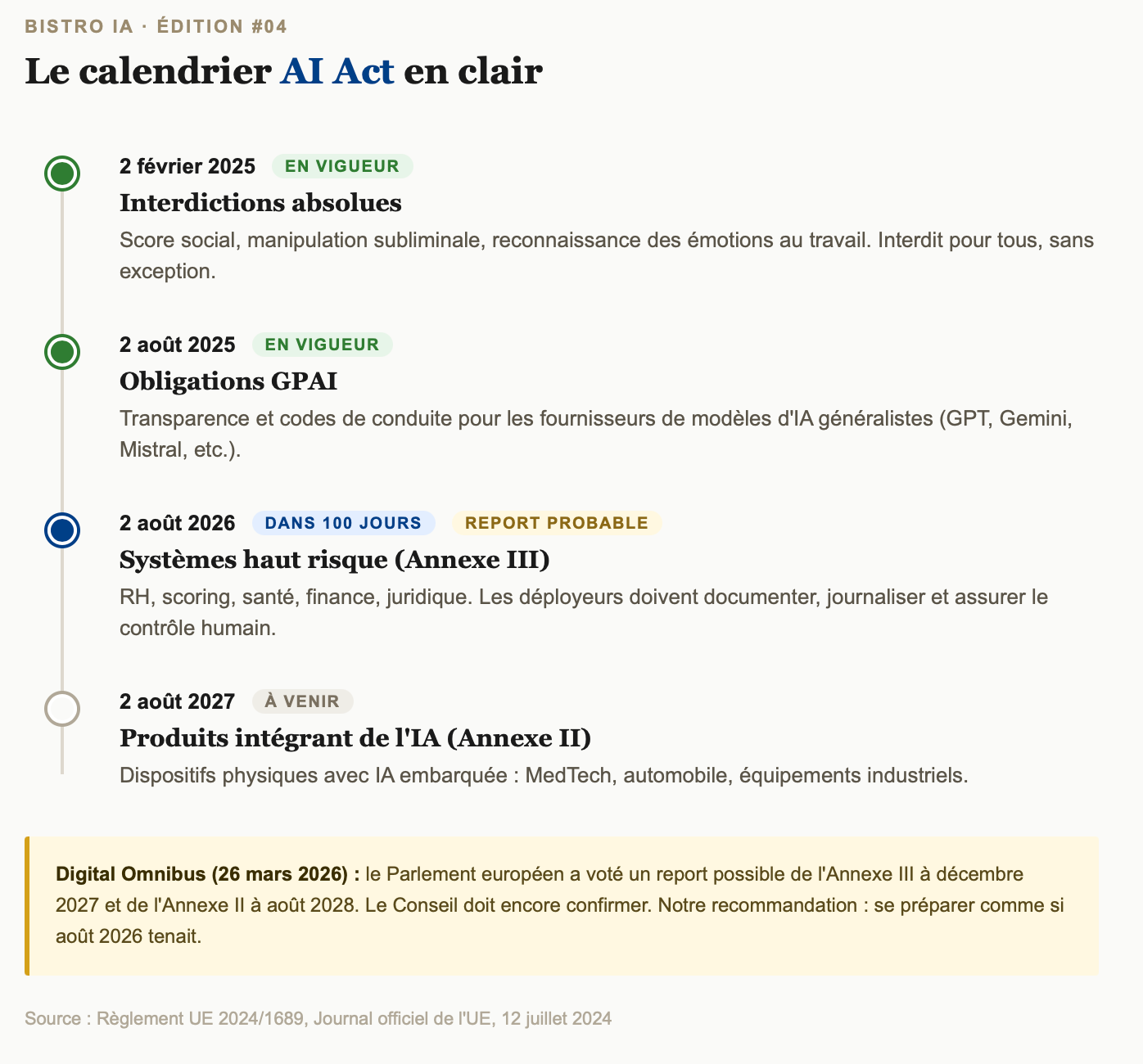

⚙️ LA MOUTURE : Le calendrier réel, simplifié

Les 4 dates à retenir

(Source : Règlement UE 2024/1689 du Parlement européen et du Conseil, Journal officiel de l’UE, 12 juillet 2024)

Note importante : le vote Digital Omnibus du 26 mars pourrait repousser l’échéance annexe III à décembre 2027 et annexe II à août 2028. Le texte doit encore être confirmé par le Conseil. Notre recommandation : se préparer comme si août 2026 tenait, tout en sachant qu’un report est probable.

Les 8 pratiques interdites (en vigueur depuis le 2 février 2025)

-

Systèmes de score social par les autorités publiques

-

Exploitation de vulnérabilités (âge, handicap, situation sociale)

-

Manipulation subliminale causant un préjudice

-

Identification biométrique à distance en temps réel dans l’espace public (sauf exceptions)

-

Catégorisation biométrique par race, opinions politiques, orientation sexuelle

-

Scraping non ciblé d’images faciales sur internet

-

Reconnaissance des émotions sur le lieu de travail et dans l’éducation (sauf raisons de sécurité)

-

Police prédictive basée uniquement sur le profilage

(Source : Article 5, Règlement UE 2024/1689, en vigueur depuis le 2 février 2025)

Si votre PME n’utilise aucune de ces pratiques (ce qui est le cas de l’immense majorité), vous êtes en conformité sur ce volet.

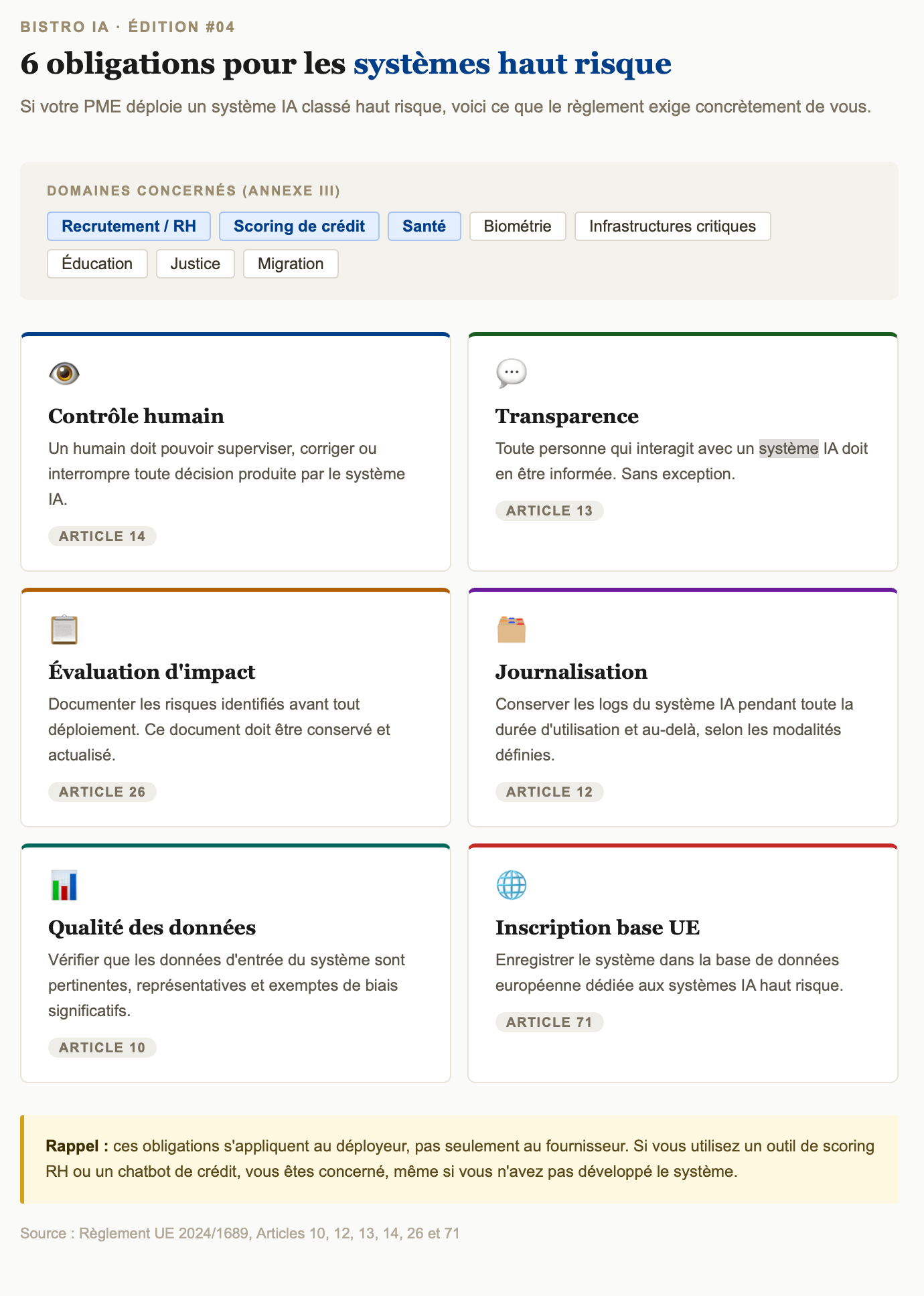

Ce qui change pour les systèmes haut risque

L’annexe III liste les domaines sensibles : biométrie, infrastructures critiques, éducation, emploi/RH, services essentiels (crédit, assurance), application de la loi, migration, justice.

Concrètement pour une PME, les cas les plus fréquents sont :

- Scoring de candidats avec un outil IA (recrutement) → haut risque

- Scoring de crédit client automatisé → haut risque

- Chatbot service client qui oriente vers des services essentiels → possiblement haut risque (dépend des décisions qu’il automatise et de leur impact sur l’accès au service)

- Résumé automatique de réunions → pas haut risque

- Génération de contenu marketing → pas haut risque

Les obligations concrètes pour un déployeur de système haut risque

🔥 LA TORRÉFACTION : Ce que les guides de conformité ne vous disent pas

Soyons honnêtes : la plupart des “guides AI Act pour PME” sont écrits par des cabinets de conseil qui vendent des missions de conformité. Leur intérêt est de rendre le texte aussi complexe et anxiogène que possible.

La réalité est plus nuancée. Pour la majorité des PME françaises, l’AI Act n’impose rien de dramatique. Pourquoi ? Parce que la plupart des usages IA en PME (ChatGPT, Copilot, outils de rédaction, automatisation marketing) ne tombent pas dans la catégorie haut risque.

Ce qui est réellement urgent :

1. Identifier si vous avez un usage haut risque (recrutement, scoring, santé). Si non, votre exposition est limitée.

2. Vérifier vos contrats fournisseurs IA. C’est le fournisseur qui porte la majorité des obligations de conformité technique. Mais vous, en tant que déployeur, devez vous assurer qu’il les respecte.

3. Mettre en place la transparence. Si vos clients interagissent avec un chatbot IA, ils doivent le savoir. C’est simple à implémenter et c’est obligatoire.

L’autre angle mort : les allègements PME existent sur le papier (article 62 du règlement), mais leurs modalités pratiques ne sont pas encore définies. Le texte prévoit l’accès à des bacs à sable réglementaires, une documentation allégée et des sanctions proportionnées à la taille de l’entreprise. Aucune autorité nationale n’a encore publié de guide d’application concret. Ce flou est réel, et il faut le nommer.

Le vrai risque pour une PME, ce n’est pas l’amende de 35 M€. C’est de perdre un appel d’offres parce qu’un donneur d’ordres exige la conformité AI Act comme prérequis. Ça, ça commence déjà à arriver.

🏢 LE BLEND : INESIA et CNIL · Couche Régulation

Pour ce numéro, le Blend zoome sur la couche 9 : Régulation et Certification. Deux acteurs structurants pour naviguer dans l’AI Act.

CNIL. Couche 9 · Régulation 🟢

La Commission Nationale de l’Informatique et des Libertés est l’autorité de référence pour l’AI Act en France dès que des données personnelles sont impliquées, ce qui couvre la grande majorité des usages en PME. Elle collabore avec la DGCCRF et l’Arcom selon les domaines concernés.

Ce que peu de dirigeants savent : la CNIL a publié depuis 2024 une série de fiches pratiques sur l’IA (encadrement des modèles, données d’entraînement, droits des personnes) qui constituent la meilleure ressource gratuite disponible en français pour comprendre les obligations. Elle pilote également les bacs à sable réglementaires français, ouverts aux PME qui veulent tester leur conformité sans risque.

Ce que ça change pour vous : avant de payer un cabinet de conseil, lisez les fiches CNIL. C’est gratuit, officiel, en français, et c’est la source que les cabinets utilisent eux-mêmes. → cnil.fr/intelligence-artificielle

INESIA · Couche 9 · Certification 🟡

L’Institut National pour l’Évaluation et la Sécurité de l’Intelligence Artificielle est l’organisme français chargé d’évaluer la conformité des systèmes IA au regard de l’AI Act. Il est piloté conjointement par le SGDSN (Secrétariat Général de la Défense et de la Sécurité Nationale) et la DGE (Direction Générale des Entreprises), et regroupe quatre acteurs : ANSSI, Inria, LNE et PEReN. Sa feuille de route 2026-2027 a été adoptée : l’institut est opérationnel. → economie.gouv.fr

Son périmètre couvre l’analyse des risques systémiques, le soutien à l’application du règlement, et l’évaluation des performances et de la fiabilité des modèles IA, avec un ancrage explicite sur les articles 8 à 15 de l’AI Act (fiabilité, transparence, supervision humaine, gouvernance des données).

Ce que ça change pour vous : si vous développez ou intégrez un système IA haut risque, INESIA définira les critères d’évaluation en France. C’est l’interlocuteur à suivre pour la certification, pas un cabinet généraliste.

☕ LE SERVICE : Ce que vous pouvez faire cette semaine

OK, l’AI Act c’est 458 pages. Mais vous, dirigeant d’une PME de 80 personnes à Nantes ou Lyon, vous faites quoi lundi matin ?

1. Faites l’inventaire de vos usages IA en 30 minutes

Listez tous les outils IA utilisés dans votre organisation : ChatGPT, Copilot, outils RH, scoring, chatbot, automatisation. Pour chacun, notez : qui l’utilise, quelles données il traite, quel fournisseur. C’est la base. Sans cet inventaire, tout le reste est abstrait.

2. Posez 5 questions à vos fournisseurs IA

Envoyez cet email à chaque fournisseur IA (adaptez-le à votre contexte) :

- Votre système est-il classé “haut risque” au sens de l’AI Act ?

- Disposez-vous d’une documentation technique conforme au règlement ?

- Où sont hébergées et traitées nos données ?

- Quel est votre plan de conformité AI Act et son calendrier ?

- Proposez-vous un accompagnement à la mise en conformité pour vos clients ?

Temps estimé : 15 minutes par fournisseur.

3. Consultez les fiches pratiques CNIL sur l’IA

C’est la ressource la plus utile et la plus accessible pour une PME française. Gratuit, officiel, en français. → cnil.fr/intelligence-artificielle

🥐 LE MOT DU BARISTA

L’AI Act fait peur. C’est normal. 458 pages de texte juridique européen, des catégories de risque, des annexes, des exceptions, un calendrier à tiroirs... C’est conçu pour être intimidant.

Mais pour la grande majorité des PME françaises, la réalité est beaucoup plus simple que le texte le laisse penser. Si vous n’utilisez pas l’IA dans le recrutement, le scoring, ou la santé, votre exposition est limitée. Si vous utilisez des outils IA standard (ChatGPT, Copilot, outils de rédaction), vos obligations se résument à la transparence et au bon sens.

Ce que je retiens de ce travail de recherche : le vrai enjeu de l’AI Act pour les PME, ce n’est pas la conformité technique. C’est la lisibilité. Le texte est là. Les obligations sont claires pour qui les lit. Mais entre le règlement et le dirigeant de PME, il y a un fossé de traduction que trop peu d’institutions comblent. C’est exactement ce que Bistro IA est là pour faire.

Est-ce que votre entreprise a commencé à se préparer ? Répondez à cet email, je lis chaque réponse.

Vous connaissez un dirigeant de PME ou un DPO qui se noie dans l’AI Act ? Transférez-lui cet email. C’est plus utile qu’un webinaire de 90 minutes.

Yves ☕

🍪 LE PETIT EXTRA

Prochaine édition (#05) : _Mistral AI : champion français ou mirage ?_Analyse factuelle de la décacorne la plus médiatisée de France. Forces, limites, valorisation, et ce que ça change concrètement pour votre PME.

Ressource bonus : Le texte intégral du règlement en français est disponible sur EUR-Lex. 458 pages, mais l’annexe III (systèmes haut risque) et l’article 5 (interdictions) sont les deux sections à lire en priorité. → EUR-Lex, Règlement UE 2024/1689

Une question pour vous : Quel est l’usage IA dans votre entreprise qui vous inquiète le plus vis-à-vis de l’AI Act ? Répondez à cet email, je compilerai les cas concrets dans un prochain numéro.

Rejoindre la newsletter Bistro IA

Recevez des analyses pragmatiques sur l'IA, le produit, et le code. Pas de bullshit, juste des signaux clairs envoyés directement dans votre boîte mail.